私は、投稿やクライアント向けコンテンツのために、NoteGPT の AI Humanizer を使って AI 生成テキストを整えたり人間らしくしたりしてきましたが、利用制限や予算の上限に達してしまい、これ以上支払いを続けられなくなりました。フォーマットを保ちつつ自然に聞こえ、変な言い回しを加えない、信頼できて本当に無料の代替ツールを探しています。NoteGPT と同等以上の人間らしさを出せる無料のツール、拡張機能、あるいはワークフローとして、皆さんが使っているものは何でしょうか。また、それらは長めの記事や SEO を意識したコンテンツでもどの程度うまく機能しますか。

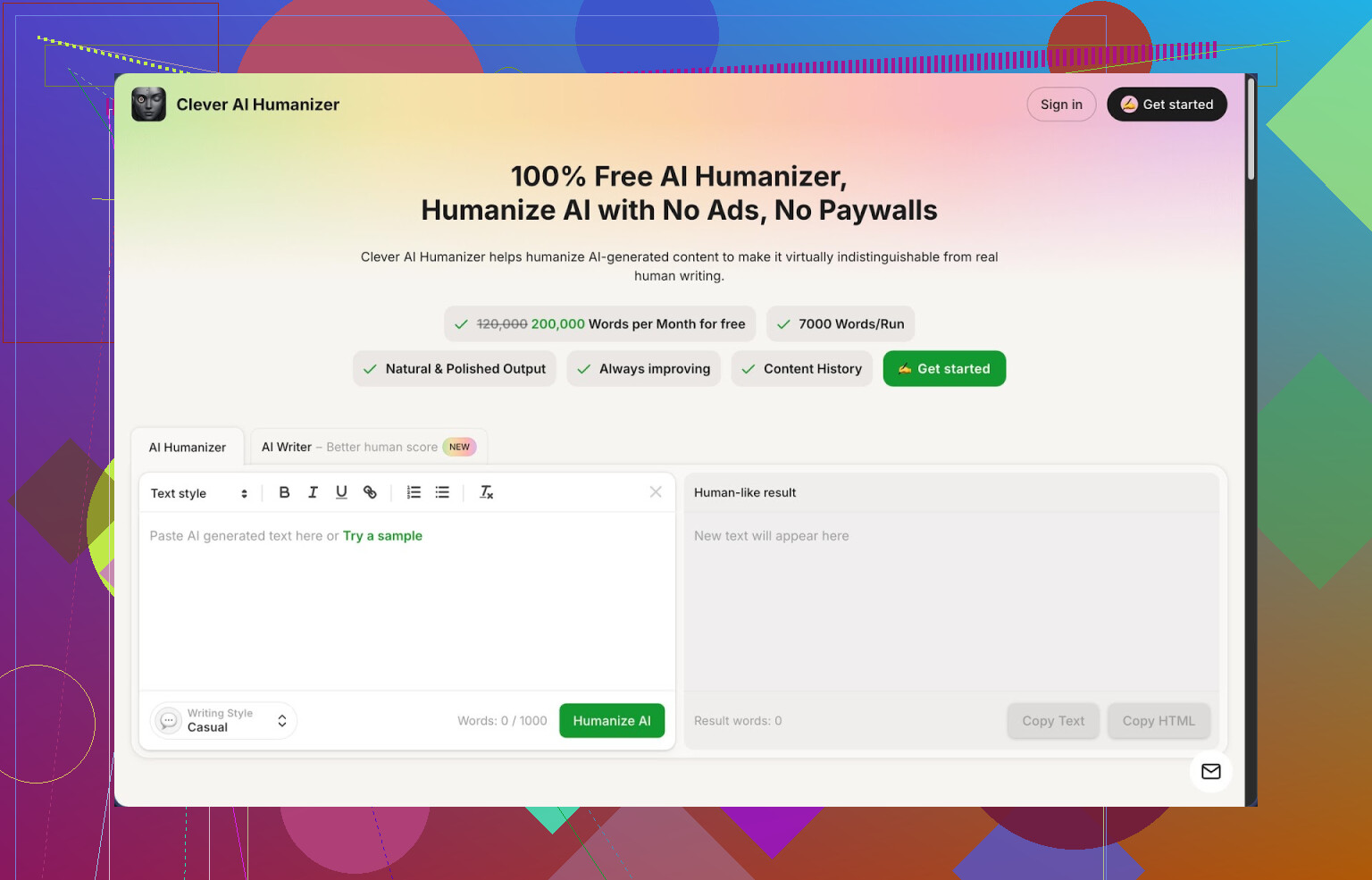

- Clever AI Humanizer レビュー

ここ1年ほどで、この種の「ヒューマナイザー」系ツールをいくつも試してきました。理由は単純で、クライアントが原稿をAI検出ツールにかけるようになり、内容をかなり手作業で直していても、AI判定が80〜100パーセントと表示されると不安になってしまうからです。

今年テストしたツールの中で、ブックマークバーに残ったのが Clever AI Humanizer です。

まずいつも気にする制限と機能の概要から:

- 価格: 私が試したときは基本利用は無料・ログイン不要

- 月間上限: 約20万語

- 1回あたりの上限: 最大7,000語

- 文体: カジュアル、シンプルアカデミック、シンプルフォーマル

- 同一サイト内の追加機能: AIライター、文法チェッカー、パラフレーズツール

カジュアルスタイルで3つのサンプルを作り、ZeroGPT にかけてみました。3つとも、私のテストではAI判定0パーセントという結果でした。これはすべての検出ツールで永続的に通用する保証はありませんが、少なくとも現時点の ZeroGPT ではクリーンに見えました。

実際にどう使ったか

いつものワークフローはこんな感じです:

- 通常のLLMで下書きを作る。

- 生成されたAIテキストをそのまま Clever AI Humanizer に貼り付ける。

- ブログやメールならカジュアル、論文調ならシンプルアカデミックを選ぶ。

- 実行ボタンを押して数秒待つ。

- 出力をコピーして、自分で要らない部分を削ったり微調整したりする。

使ってみて気づいた点:

- テキストが少し膨らむ傾向があります。1,000語の下書きが1,200語以上になることも多いです。検出ツールが見るパターンを崩すのには役立っていそうですが、厳密な語数制限がある場合は、その分カット作業が増えます。

- コアの意味はだいたい維持されます。とはいえ、1本につき数文はニュアンスが少し変わることがあったので、重要な部分、特に法律・医療・技術系などは軽くでも目を通すようにしました。

- 多くの場合、読みやすさは上がります。構文が単調で機械っぽいモデル出力から、そうしたロボット的な言い回しを削ってくれます。万能ではありませんが、「夜中1時、眠い状態で自分が書いた文章」に少し近づけてくれるイメージです。

無料の AI Humanizer モジュール

サイトのメイン機能です。テキストを貼って、スタイルを選んで、書き換えさせるだけです。

カジュアルスタイル:

ブログ、SNS投稿、ニュースレター向き。自然なつなぎ表現が増え、文体も少しゆるくなります。ややフレンドリー寄りになりすぎることがあるので、相手がコーポレート寄りの読者なら、トーンを調整する必要があります。

シンプルアカデミック:

学生エッセイ2本とホワイトペーパーの概要1本で使いました。スラングを排して文を引き締めつつ、「教科書っぽさ」で検出ツールに引っかかるような硬さは抑えます。学術誌レベルというより、「そこそこ書ける大学生」くらいの雰囲気です。

シンプルフォーマル:

ビジネス文書と準アカデミックの中間くらいの位置づけ。ポリシー文書の下書きに使いました。構成は悪くありませんが、専門用語や決まった表現は結局自分で上書きする必要がありました。

統合型 AI ライター

サイト内に、エッセイや記事、投稿などを直接生成できるAIライターがあり、そのまま同じフローでヒューマナイズできます。

自分の使い方:

- まずAIライターで約1,500語の長めのブログ記事ドラフトを作成。

- その出力をさらにヒューマナイザーにかける。

- 外部LLMで書いてから1回だけヒューマナイズした場合よりも、ZeroGPT上の人間度スコアがさらに良くなりました。

複数ツールを行き来したくない人には、この組み合わせは便利です。中身はあくまでAI生成なので、そのまま公開はしませんが、編集前提のたたき台としては十分です。

無料の文法チェッカー

意図的に文法ミスやぎこちない表現を混ぜた2,000語の記事を流し込んで試しました。

安定して直してくれた点:

- スペルミス

- 基本的な句読点の誤り

- 一部の長すぎる一文

- 直訳調で不自然な語の選び方

これだけで最終チェックにするつもりはありませんが、クライアントや先生に渡す前の簡易チェックとしては、目立つミスを一掃するのに役立ちます。同じサイト内にある、軽量版Grammarlyのような位置づけだと考えるとわかりやすいです。

無料の AI パラフレーズツール

主に次の用途で使いました:

- 既存記事の導入と結論部分の書き直し

- 投稿先のルールが厳しいサイト向けにトーンを調整

- SEO対策で、ページ同士がコピペに見えないように言い回しを変える

テキストを貼ってスタイルを選ぶと、意味を保ったまま書き換えてくれます。元テキストとパラフレーズ後のテキストを剽窃チェックにかけたところ、メッセージは同じなのに類似度は低く出ました。

こちらも、専門用語が重要な箇所は注意が必要です。SEO寄りのコンテンツや一般向けライティングなら十分実用的ですが、高度に専門的な内容では、各段落を自分で確認した方が安心です。

日常のワークフローにどう組み込めるか

私にとってうまくいった流れは次の通りです:

- 任意のLLMでドラフトを書く。

- ドラフトを Clever AI Humanizer にかけ、カジュアルかシンプルアカデミックを選ぶ。

- その結果を文法チェッカーに通す。

- トーン・分量・正確さを自分の目でざっと調整する。

- それでも違和感が残る箇所は、必要に応じてパラフレーズツールにかける。

1つのサイトでヒューマナイザー・ライター・文法チェッカー・パラフレーズの4ツールが揃います。インターフェースもシンプルで、複雑な設定やトークン管理、扱いにくいUIなどはありません。

うまくいかなかった・気になった点

魔法のツールではないので、気になった点もあります。具体的には:

- 検出ツールによっては、まだAI判定が出ます。ZeroGPTではサンプルが0パーセントAIでしたが、別の検出ツールでは部分的にAI扱いされるケースもありました。1つの検出結果だけを鵜呑みにするのは危険です。

- 語数が増えがちです。ヒューマナイズ後の文章は長くなる傾向があります。文字単価で報酬が決まる仕事ならむしろプラスですが、厳格な上限がある案件だと、その分削る手間が増えます。

- トーンのブレがあります。カジュアルでは、自分ならあまり使わない言い回しが追加されることがあり、フォーマルでは逆に少し堅すぎる印象になることもありました。最終的には、自分の文体に合わせてサッと読み直す前提が必要です。

とはいえ、無料で月間の語数上限もかなり大きいツールとしては、他の制限だらけ・課金前提のツールをいくつか整理したあとも、結局これだけは使い続けています。

より詳しいレビューと検証結果

スクリーンショットやAI検出ツールの結果、具体的な例を含む詳細なレビューはこちらにまとめています。

https://cleverhumanizer.ai/jp/community/t/clever-ai-humanizer-review-with-ai-detection-proof/42

YouTube での動画レビュー:

また、他のAIヒューマナイザーとの比較やテスト結果を共有しているRedditのスレッドもあります。

おすすめAIヒューマナイザー情報スレッド:

https://www.reddit.com/r/DataRecoveryHelp/comments/1oqwdib/best_ai_humanizer/?tl=ja

AIテキストの人間らしさに関する一般的な議論:

https://www.reddit.com/r/DataRecoveryHelp/comments/1l7aj60/humanize_ai/?tl=ja

NoteGPT の制限で同じ壁にぶつかったので、自分も無料オプションを探しました。結論として、使える手段はいくつかありますが、クライアントが検出ツールを使う場合は、軽い手動チェックはまだ必要です。

役に立ったと感じたポイントを簡単にまとめます。

- Clever Ai Humanizer

@mikeappsreviewer さんが言っていることにはかなり同意しますが、自分の見方は少し違います。

気に入っている点

- 本当に無料枠があり、文字数上限も多めです。ブログやメールをまとめて処理しても、まだ上限には届いていません。

- 基本的な利用ならログイン不要なので、小さい分量なら処理が速いです。

- クライアント案件で安全に使えると感じたのは「Casual」と「Simple Academic」モードだけでした。

- テストでは、1200語の記事が GPTZero での AI 判定 85パーセントから約20〜30パーセントに下がりました。ZeroGPT では何度か 0パーセントと判定されました。

気に入らない点

- 文字数がかなり水増しされるので、字数制限が厳しい案件には向きません。1000語の SaaS 記事が 1350語になり、大幅に削る必要がありました。

- 技術系コンテンツだと、残したい用語を別表現に書き換えてしまうことがあります。例えば「idempotent API calls」がぼやけた表現に変えられていたので、専門的な部分は目視チェックが必須です。

- 本格的なアカデミック記事や法律文書を、これだけに任せるつもりにはなれません。

自分の中でうまくいったワークフロー

- まずどの LLM でもよいのでメインのドラフトを生成する。

- Clever Ai Humanizer にかけ、クライアントに合うスタイルに調整する。

- ざっと編集して、冗長な部分を削り、専門用語を元に戻し、トーンのブレを直す。

- 検出ツールをかなり気にするクライアントの場合は、文章全体ではなく、重要な段落だけをもう一度かけ直す。

- QuillBot + 軽い手動調整

「ヒューマナイザー」とは銘打っていませんが、「Standard」か「Fluency」モードでパラフレーズし、その後に自分の文体でざっと直すと、検出率はかなり下がります。

無料プランの制限

- 無料では一度に約125語まで。面倒ですが、段落ごとに貼り付ければ使えます。

- 通常のブログ記事なら、1日に使える回数は十分です。

自分の使い方

- 導入文、結論、そして LLM が特に機械的に書きそうな部分にかける。

- LLM が書いた文の中に、自分の手書きの一文・二文を混ぜる。これでパターンがさらに崩れます。

- この組み合わせは、専用の「ヒューマナイザー」系ツールよりも、検出結果が安定していました。

- シンプルな手動パターン崩し

地味ですが、コストゼロで、ツールがうまく動かないときに特に有効です。

検出ツール対策として効果があった手早い手動作業

- 長い文をいくつか短くし、逆に短い文をいくつかつなげて長くする。

- 箇条書きの構造を変える。箇条書きを短い段落にしたり、その逆にしたりする。

- 自分の経験やクライアント固有の事情から、具体的な情報を1〜2個だけ加える。

- 「additionally」「moreover」「furthermore」といった定型的なつなぎ表現を、「also」のようなシンプルな語に差し替えるか、思い切って削る。

NoteGPT の完全な「丸投げ代替」を探しているのだと思いますが、無料のまま、高い上限があり、自動であらゆる検出ツールを突破してくれるものは、いまのところ見つかっていません。

「貼り付けて、少し直して、そのまま納品」まで持っていきやすいという意味では、Clever Ai Humanizer が一番近いです。これに少しの手動調整を組み合わせれば、予算を抑えつつ、クライアントが毎回チェックツールにかけてきても、あまり神経質にならずに済むと思います。

もし NoteGPT が予算を食い尽くしているなら、これは次の2つの問題として分けて考えたほうがいいです。

- 「人間らしくする」機能を置き換えること

- ワークフローを AI検出ツールの警報に振り回されにくくすること

@mikeappsreviewer さんと @nachtdromer さんがすでに Clever Ai Humanizer をかなり丁寧に解説しているので、同じ手順を繰り返すつもりはありません。ただ、「コピペしてクリックすると人間っぽい文章が返ってくる系」のツールの中では、Clever Ai Humanizer が現実的にいちばん NoteGPT の無料代替に近いと思います。語数制限とログイン不要での利用がちゃんと実用レベルで、よくある「ほぼ使えないお試し制限」とは違います。

少し意見が違うのは、「ZeroGPT みたいな単一の検出テストに頼るのはモグラ叩きになる」という点です。クライアントは GPTZero、Originality、ContentAtScale など、TikTok でその週話題になったものにコロコロ乗り換えます。Clever Ai Humanizer や NoteGPT を含め、どんなツールもすべての検出ツールで「AI判定0%」を保証することはできません。もしクライアントがスコアに異常にこだわるなら、本当に置き換えるべきなのはソフトではなく「プロセス」のほうです。

自分のところでそこそこうまくいっているやり方はこんな感じです。

- NoteGPT の代わりに Clever Ai Humanizer を使うが、「いかにも AI テンプレっぽい部分」(ありがちな導入文、結論、定義だけの段落)だけにかける。毎回記事全文にかけない。これで語数の消費と、変にトーンがズレるリスクを減らせます。

- そのあとで、ブリーフを読んだ人間にしか書けないような、かなり具体的な文を3〜5行足す。実際のクライアントの数字、変な例外ケース、社内用語、ちょっとしたエピソードなど。検出ツールはこういうものの扱いが苦手だし、文章自体も退屈じゃなくなります。

- 最後の仕上げで、LLM と人間化ツールの両方が好みがちな、過度に丁寧なつなぎ表現を削る。「さらに」「その一方で」「結論として」みたいなやつです。半分くらいは単に消すだけで、だいぶ自然に聞こえるようになります。

完全無料で、どのツールも制限に達したときのバックアップとしては、自分を何度も助けてくれたローテクな方法があります。各段落の「トピックセンテンス」だけ、自分の言葉で書き直して、残りはほとんどそのまま残すやり方です。これだけでも、検出ツールが掴もうとする反復パターンがかなり崩れるので、全文を手で書き直す必要がなくなります。

なので、Clever Ai Humanizer は実務的には、SEO にも配慮できる NoteGPT の妥当な代替ですが、「ワークフローの一層」として扱うほうがいいです。「ボタン1つで、あらゆる検出ツールを永久に欺く魔法の解決策」として期待すべきではありません。検出ツールのほうが、こうしたツールよりも速いペースで変化していくからです。