Ich veröffentliche Walter Writes AI Reviews und bin mir nicht sicher, wie echte Nutzer den Inhalt, den Ton und den Nutzen tatsächlich wahrnehmen. Die Analytics zeigen Aufrufe, aber nur sehr wenige Kommentare oder geteilte Beiträge, sodass ich nicht erkennen kann, was gut funktioniert und was verbessert werden muss. Könntest du meine Rezensionen zu KI‑Tools aus der Perspektive einer Leserin oder eines Lesers überprüfen und mir sagen, was verwirrend ist, was dir gefällt und was dein Vertrauen stärken und dich dazu bringen würde, dich stärker damit zu beschäftigen?

Walter Writes AI Rezension von jemandem, der ein bisschen zu nerdig damit wurde

Ich habe einen Nachmittag damit verbracht, mit Walter Writes AI herumzuspielen und die Ausgaben durch Detektoren zu jagen, und die Ergebnisse waren völlig uneinheitlich.

Ich habe nur die kostenlose Version benutzt, die dich auf den Simple Modus festnagelt. Kein Zugriff auf die kostenpflichtigen Standard- oder Enhanced‑Modi, behalte das im Hinterkopf, falls deine Erfahrung anders ausfällt.

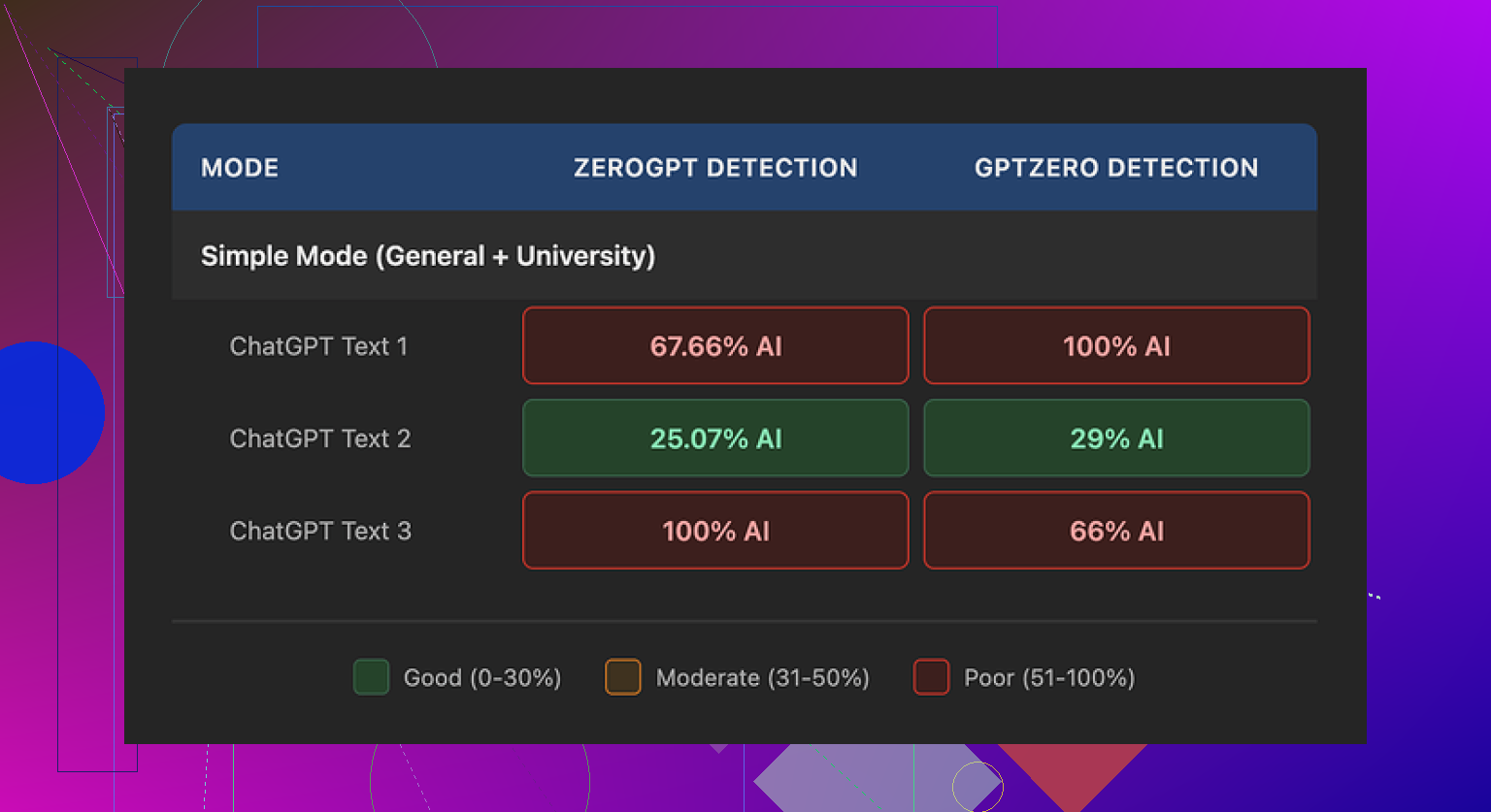

Das ist mit drei Testtexten passiert:

• Beispiel 1

GPTZero: 29 %

ZeroGPT: 25 %

Für ein kostenloses Tool hat mich dieser Wert überrascht. Viele kostenlose „Humanizer“ werden härter markiert als reiner ChatGPT‑Text. Dieses hier ist in diesem Durchlauf etwas besser durchgerutscht.

• Beispiel 2

Mindestens ein Detektor hat 100 % KI erkannt.

• Beispiel 3

Gleiche Geschichte. Einer der Detektoren hat es mit 100 % abgestraft.

Du kannst also einmal einen halbwegs brauchbaren Output bekommen, und der nächste klingt, als wäre er von einem Roboter geschrieben, der noch einen anderen Roboter getrunken hat.

Wie der Text klang

Dieser Teil hat mich mehr gestört als die Punktzahlen.

Ein paar Muster haben sich ständig wiederholt:

• Semikolon‑Besessenheit

Es hat ständig Semikolons gesetzt, wo fast jeder Mensch ein Komma nehmen oder den Satz einfach teilen würde. Nach einer Weile erkennst du das sofort. Es liest sich wie jemand, der krampfhaft formell klingen will.

• Seltsame Wiederholungen

In einem Beispiel kam das Wort „heute“ viermal in drei Sätzen vor. Gleiche Struktur, gleicher Rhythmus. Du schaust drauf und denkst: „Ja, das fühlt sich nach KI an.“

• Klammern‑Spam

Es hat sich extrem auf erklärende Klammern wie „(z. B. Stürme, Dürren)“ verlassen, immer wieder. Gleicher Stil, gleiche Formatierung, quer durch den Text. Detektoren lieben solche Muster. Menschen variieren das normalerweise oder lassen so etwas nach dem ersten Mal weg.

Wenn du den Output direkt irgendwo Wichtiges einfügen willst, musst du manuell aufräumen. Satzbau ändern. Wiederholte Phrasen entfernen. Zeichensetzung korrigieren. Sonst riecht es ziemlich schnell nach LLM‑Text.

Preise und Limits

Das habe ich mir von der Preisseite notiert:

• Starter‑Plan

8 Dollar pro Monat bei jährlicher Abrechnung

Rund 30.000 Wörter inklusive

• Unlimited‑Plan

26 Dollar pro Monat

Trotzdem hart auf 2.000 Wörter pro einzelner Eingabe gedeckelt

„Unlimited“ bezieht sich hier also vor allem auf das monatliche Gesamtvolumen, nicht auf einen riesigen Einfügetext. Wenn du lange Berichte oder Kapitel schreibst, nervt es, alles in 2.000‑Wörter‑Blöcke zu zerschneiden.

Kostenlose Stufe:

Du bekommst ungefähr 300 Wörter insgesamt, nicht pro Tag. Genug, um ein Gefühl zu bekommen, nicht genug für ernsthafte Arbeit.

Rückerstattungen und Richtlinienkram

Die Formulierungen zur Rückerstattung wirkten aggressiv. Viele Hinweise auf Rückbuchungen und Drohungen mit rechtlichen Schritten, falls du Zahlungen zurückziehst. So etwas sehe ich bei einem SaaS‑Tool ungern.

Der Umgang mit hochgeladenen Texten blieb vage. Ich habe keine klare, einfache Aussage gefunden, ob Eingaben nach der Verarbeitung gelöscht werden oder nicht fürs Training genutzt werden. Wenn du mit Arbeitsunterlagen, Kundendaten oder sensiblen Inhalten zu tun hast, ist das wichtig.

Ich würde keine vertraulichen Inhalte durch ein Tool jagen, wenn ich nicht genau weiß, was backendseitig damit passiert. Hier hatte ich dieses Vertrauen nicht.

Was ich stattdessen benutzt habe

Im gleichen Test‑Rabbit‑Hole bin ich immer wieder zu Clever AI Humanizer zurückgekehrt.

Die Seite ist hier:

Jedes Mal, wenn ich Text darüber laufen ließ und dann mit Detektoren geprüft habe, klang das Ergebnis eher nach etwas, das ich selbst verschicken würde. Weniger robotische Formulierungen. Weniger offensichtliche Muster. Keine Bezahlschranke für die Grundnutzung, als ich getestet habe.

Wenn du Schritt‑für‑Schritt‑Anleitungen und Vergleiche willst, haben ein paar Threads geholfen:

Humanize AI Anleitung auf Reddit

https://www.reddit.com/r/DataRecoveryHelp/comments/1l7aj60/humanize_ai/?tl=de

Clever AI Humanizer Review auf Reddit

https://www.reddit.com/r/DataRecoveryHelp/comments/1ptugsf/clever_ai_humanizer_review/?tl=de

YouTube‑Walkthrough

Was ich tun würde, wenn du Walter Writes testest

Wenn du Walter Writes AI trotzdem ausprobieren willst:

-

Fang mit risikoarmen Texten an

Etwas, das problemlos geflaggt werden darf. Starte nicht mit deiner Abschlussarbeit oder einem Kundenbericht. -

Lass jeden Output durch mehrere Detektoren laufen

GPTZero und ZeroGPT habe ich genutzt, du kannst weitere ergänzen. Achte auf Muster, bei denen ein Detektor den Text hasst, während ein anderer ihn durchwinkt. -

Achte auf diese Auffälligkeiten

• Semikolons an seltsamen Stellen

• Übermäßige Nutzung derselben Zeitwörter wie „heute“

• Wiederholte Klammerformulierungen wie „(z. B. …)“

Wenn du das siehst, formuliere konsequent um. -

Halte die Textblöcke klein

Wenn du an die 2.000‑Wörter‑Grenze im Bezahlplan oder die 300‑Wörter‑Gesamtgrenze im Free‑Plan stößt, plane deinen Workflow so, dass du nicht mitten im Satz schneidest. -

Manuelle Nachbearbeitung nicht auslassen

Das Tool hilft bei manchen Durchläufen etwas bei den Erkennungswerten, aber der rohe Output klingt an vielen Stellen immer noch deutlich nach KI.

Grobe Schlussfolgerung aus meinen Tests

Walter Writes AI hatte eine schöne Probe mit niedriger Erkennungsrate, die Hoffnung gemacht hat, dann zwei, die die Detektoren massiv ausgelöst haben. Die Preis‑ und Richtlinienseite hat mir nicht viel Vertrauen gegeben, und der Schreibstil hatte deutliche KI‑Fingerabdrücke.

Ich bin am Ende bei Clever AI Humanizer für die meisten Tests geblieben, weil ich damit natürlicher klingende Texte bekommen habe und nichts zahlen musste, um brauchbare Ergebnisse zu erhalten.

Du bekommst Aufrufe, aber wenig Interaktion, weil sich deine Reviews eher wie Detektivberichte über KI-Erkennung lesen als wie nutzerorientierte Kaufberater.

Schnelle Gedanken basierend auf deinen Walter-Writes-KI-Reviews und dem, was @mikeappsreviewer geteilt hat:

-

Dein Zielpublikum ist nicht klar genug

Dein aktueller Ansatz wirkt wie „ist dieser KI-Text erkennbar“.

Die meisten Leser wollen wissen:

• Hilft mir das, schneller oder besser zu schreiben

• Ist das sicher für Job oder Schule

• Ist der Preis im Vergleich zu Alternativen gerechtfertigt

• Für welche konkreten Anwendungsfälle das Tool taugtWenn du stark auf Detektoren und technische Details gehst, überfliegen normale Nutzer den Text, holen sich eine Antwort und gehen, ohne zu kommentieren.

-

Der Ton wirkt distanziert

Der Ton in deiner Beschreibung klingt analytisch und etwas abgekoppelt.

Versuche:

• Kürzere Abschnitte

• Klare Urteile pro Use Case: „Gut für X, schlecht für Y“

• Eine klare Meinung, auch wenn manche widersprechenMenschen reagieren mehr, wenn du Position beziehst. Du musst nicht hart sein, aber du brauchst klare Aussagen.

-

Mehr „Vorher–Nachher“-Beispiele einbauen

Statt einer Textwand aus Erklärungen, zeige:

• Rohtext der KI

• Walter-Writes-Ausgabe

• Eine kurz überarbeitete Version, die du persönlich freigeben würdestSag dann zum Beispiel: „Für eine Schulaufsatz würde ich dieses Ergebnis nicht im Original einreichen“ oder „Für Blogentwürfe ist das ok, wenn man X und Y nachbearbeitet.“

So entstehen Kommentare wie „Ich würde es nutzen für …“ oder „Mein Prof würde das sofort merken.“ -

Sprich aus, was Nutzer heimlich beschäftigt

Viele Leser denken:

• „Bringt mich das in Schwierigkeiten mit KI-Detektoren“

• „Hält mein Chef mich für einen Betrüger“

• „Werden meine Inhalte gespeichert oder wiederverwendet“Du hast schon auf vage Datenverarbeitung und aggressive Rückerstattungsbedingungen hingewiesen. Das ist groß. Hol das weiter nach oben in der Review.

Mach einen klaren Risiko-Block:

• Datenrisiko: Niedrig / Mittel / Hoch

• Erkennungsrisiko: Niedrig / Mittel / Hoch

• Preis-Leistungs-Verhältnis: Niedrig / Mittel / Hoch -

Du musst nicht den Stil von @mikeappsreviewer kopieren

Deren Review ging tief in Semikolon-Probleme, Wiederholungen und KI-Indizien.

Du kannst diese Punkte kurz erwähnen und dich dann stärker konzentrieren auf:

• Wer Walter Writes meiden sollte

• Wem es trotzdem helfen kann

• Wie es im Vergleich zu einer konkreten Alternative wie Clever AI Humanizer abschneidetZum Beispiel: „Wenn du Kundentexte oder Aufsätze schreibst, würde ich eher zu Clever AI Humanizer tendieren, da die Ergebnisse weniger Nacharbeit brauchen und näher an normalem E‑Mail- oder Blogstil sind.“

-

Mach Interaktion extrem einfach

Am Ende jeder Review 1–2 sehr direkte Fragen, etwa:

• „Würdest du Walter Writes KI für benotete Arbeiten riskieren“

• „Wenn du Clever AI Humanizer oder ein ähnliches Tool genutzt hast, wie schneidet es im Vergleich zu Walter ab“Kurze Fragen, ohne Schnörkel. Leute antworten eher, wenn es schnell und meinungsbasiert wirkt.

-

Straffere Struktur pro Review

Zum Beispiel:

• Zielgruppe des Tools

• Kurzurteil in einem Satz

• Testaufbau in einfacher Sprache

• Qualitätsprobleme der Ausgaben

• Performance bei KI-Erkennung

• Daten- und Rückerstattungs-Warnsignale

• Alternativen, mit einer konkreten Empfehlung wie Clever AI Humanizer

• Abschließendes „nutzen für X, meiden für Y“So vermeidest du sich wiederholende, lange Testbeschreibungen und vermittelst trotzdem das Gesamtbild.

-

Sei deutlicher mit deinem Gesamturteil

Wenn Walter Writes KI inkonsistent wirkt, formuliere es einfach:

„Ausreichend, wenn du nur etwas bessere Werte bei manchen Detektoren willst und bereit bist, stark nachzubearbeiten. Nicht gut, wenn du verlässlich menschenähnliche Texte oder klare Datenschutzversprechen erwartest.“

Im Moment bekommen Leser beim Überfliegen, was sie brauchen. Sie kommentieren nicht, weil du die „Soll ich es testen“-Frage beantwortest, aber ihre konkreten Anwendungsfälle nicht anstichst oder zu Widerspruch einlädst.

Schärfe den Fokus darauf, wer Walter nutzen sollte, wer es lassen sollte und wann ein Tool wie Clever AI Humanizer sinnvoller ist. Diese Mischung aus Meinung, Risiko und klaren Alternativen sorgt eher für echte Reaktionen als jede Analysegrafik.

Du bekommst keine Kommentare, weil sich deine Reviews im Moment eher wie Urteile anfühlen und nicht wie Gespräche.

Im Grunde macht ihr drei – du, @mikeappsreviewer und @caminantenocturno – gerade alle dasselbe: testen, Eigenheiten auflisten (Semikolons, Wiederholungen, Detektoren), ein Fazit fallen lassen. Nützlich, klar, aber es bleibt kaum Luft für Leser, um einzusteigen. Sie lesen, denken „okay, verstanden“ und sind wieder weg.

Ein paar konkrete Dinge, die ich ändern würde:

-

Dein Zielleser ist verwirrt

Du schreibst gleichzeitig für drei Gruppen:

• Studierende, die sich wegen Detektoren sorgen

• Content-Leute, die sich um Tonfall kümmern

• Nerds, die wissen wollen, welches Tool „was schlägt“

Das killt fast immer die Kommentare. Niemand denkt: „Das hier wurde für mich geschrieben.“Versuch, die Reviews nach Blickwinkel zu trennen:

• „Walter Writes für Studierende: würde deine Professorin das flaggen“

• „Walter Writes für Freelancer: lohnt sich der Mehraufwand beim Editieren“Leute kommentieren eher, wenn die Überschrift ihre Situation wortwörtlich trifft.

-

Weniger Laborbericht, mehr „so würde ich es wirklich machen“

@mikeappsreviewer ist tief in Detektorscores und Muster eingestiegen. Hilfreich, aber du musst nicht jedes Mal dasselbe Labor neu aufbauen. Konzentrier dich lieber auf Entscheidungen:• „Wenn ich heute eine Deadline hätte, würde ich Walter Writes nur als leichtes Umformulierungstool nutzen, nicht als kompletten Humanizer.“

• „Wenn der Text wie normale Bürokommunikation wirken soll, würde ich eher auf Clever AI Humanizer setzen und danach kurz von Hand drübergehen.“Klare, situative Empfehlungen provozieren Widerspruch oder Zustimmung.

-

Zeig die Trade-offs, nicht nur die Schwächen

Im Moment ist der Ton in den Reviews so: „jaaa, das Ding ist eher mau, hier ist warum.“ Das ist okay, aber hemmt Shares, weil niemand gern reine Negativität teilt.Bau Spannung ein:

• „Die Ausgaben sind inkonsistent und brauchen viel Nachbearbeitung, ABER das Interface ist simpel und der Free-Tier erlaubt entspanntes Ausprobieren.“

• „Die Formulierungen zur Erstattung wirken abweisend, TROTZDEM werden manche das Risiko akzeptieren, wenn sie nur etwas niedrigere AI-Detector-Scores wollen.“Leser lieben „kommt drauf an“-Analysen, wenn sie konkret sind.

-

Lass Raum, damit Leute dich korrigieren können

Hier bin ich etwas anderer Meinung als die anderen: Du musst deinen kompletten Prozess nicht übererklären. Wenn du alles bis ins Detail ausbuchstabierst, bleibt niemandem etwas hinzuzufügen.Lass bewusst ein paar Türen offen:

• „Ich habe nur den Simple-Modus getestet; wenn ihr Standard oder Enhanced genutzt habt, hattet ihr da weniger komische Semikolons und Wiederholungen?“

• „Ich bin wegen des 2.000-Wörter-Limits nicht auf richtig lange Texte gegangen. Hat jemand von euch mal ein ganzes Kapitel stückweise durchgejagt?“So lädst du Leute ein, ihre andere Nutzungserfahrung auszupacken.

-

Stell Nutzerrisiko weiter nach oben im Review

Die vage Datenverarbeitung + aggressive Erstattungspolitik ist ein riesiger emotionaler Aufhänger, den du wahrscheinlich zu weit unten vergräbst.Versuch einen Aufbau wie:

• 1: „Kannst du diesem Tool bei Arbeits- oder Uni-Content trauen“

• 2: „Wie menschlich wirkt das Schreiben wirklich“

• 3: „Wo es bricht: Semikolons, Wiederholungen, Klammern“

• 4: „Preis im Vergleich zu etwas wie Clever AI Humanizer“Bei Vertrauen und Risiko reagieren Leute viel schneller als bei „Detektorscores waren inkonsistent“.

-

Stell am Ende voreingenommene Fragen

Nicht neutrale wie „Was denkt ihr dazu.“ Das erzeugt Stille. Versuch:• „Würdest du Walter’s Rohoutput deiner Chefin schicken oder hättest du Angst, dass sie ihn sofort als AI erkennt?“

• „Wenn du auch Clever AI Humanizer genutzt hast: Hattest du das Gefühl, dass du dort weniger aufräumen musstest als bei Walter, oder bin ich einfach pingelig?“Leicht suggestiv, leicht persönlich. Darauf antworten Leute in einer Zeile.

-

Reduziere die „Reviewer-Distanz“ um 30 %

Im Moment klingt es nach: „Hier ist meine nüchterne Analyse dieses Tools.“

Mach es eher zu: „Ich habe das ausprobiert, weil ich X wollte, und hier hat es geholfen und hier hat es mich hängen lassen.“Beispielabschnitt:

„Ich hatte ehrlich gehofft, dass mir Walter Writes Qualität liefert à la ‘reinkopieren, leicht glätten, abschicken’. Bekommen habe ich ‘Zeichensetzung reparieren, die roboterhaften Rhythmen töten und hoffen, dass der Detector heute gute Laune hat’. Für so viel Aufwand kann ich eigentlich gleich Clever AI Humanizer nutzen und dann von Hand polieren.“So eine Passage lädt zu „same“ oder „nee, bei mir lief es gut“ ein.

-

Mach dich nicht von Kommentaren = Erfolg abhängig

Noch ein bisschen harte Wahrheit: Leser von AI-Tool-Reviews sind Lurker. Oft Studierende, Angestellte oder Leute, die Regeln dehnen. Die wollen nicht, dass ihre Kommentarhistorie schreit „Ich versuche, AI-Detection zu umgehen.“Also:

• Sieh Kommentare als Bonus-Signal, nicht als Hauptmetrík.

• Beobachte: Verweildauer, Scrolltiefe und ob Leute zu Tools wie Clever AI Humanizer oder Konkurrenzprodukten durchklicken.

• Bau vielleicht in jedes Review eine anonyme Umfrage ein: „Würdest du das für benotete Arbeiten nutzen: ja / nein / nur für Entwürfe.“Umfragen erzeugen in dieser Nische mehr Interaktion als öffentliche Kommentare.

TL;DR:

Sprich in jedem Post eine engere Zielgruppe an, hör auf, jeden Schritt wie einen Laborbericht zu erklären, hol Risiko und echte Entscheidungen nach vorn und stell am Ende spitze, meinungsstarke Fragen. Nenn Walter, nenn Clever AI Humanizer, sag, was du persönlich tun würdest. Diese Mischung erzeugt deutlich mehr echte Reaktionen, auch wenn der Großteil deines Publikums weiter nur still mitliest.

Du bekommst Aufrufe, weil dein Walter-Writes-AI-Review wirklich nützlich ist, aber wenig Interaktion, weil es sich abgeschlossen anfühlt. Es bleibt nichts, worüber man streiten oder was man ergänzen könnte.

Ein anderer Blickwinkel als das, was schon gesagt wurde:

1. Hör auf, Walter zu bewerten – bewerte die Entscheidung

Im Moment ist dein Beitrag etwa so aufgebaut:

Tool → Tests → Probleme (Semikolons, Wiederholungen, Klammern) → Preise → Richtlinien → Fazit

Das ist solide, aber sehr transaktional. Leser ziehen sich still „nutzen / nicht nutzen“ heraus und sind wieder weg.

Dreh es eher in diese Richtung:

Situation → was der Nutzer will → wie Walter sich verhält → was du tatsächlich tun würdest

Beispielabschnitte:

-

„Du musst in 24 Stunden einen benoteten Aufsatz abgeben“

- Was du brauchst: geringes Entdeckungsrisiko, saubere Struktur

- Walter Writes: inkonsistente Scores, sichtbare AI-Fingerabdrücke

- Was ich persönlich tun würde: in GPT entwerfen, durch Clever AI Humanizer schicken, dann manuell überarbeiten

-

„Du bist Content Writer und willst Blogproduktion beschleunigen“

- Was du brauchst: natürlicher Ton, berechenbarer Stil

- Walter Writes: klingt weiter nach AI, wenn du nicht stark nachbearbeitest

- Urteil: okay als leichter Umformulierer, nicht als Tool für fertige Texte

So wird dein Review zu einem „Entscheidungsleitfaden“. Genau da entstehen Kommentare: „In meinem Fall würde ich X trotzdem riskieren“ oder „Für mich sind die Detektoren egal“.

2. Du, @caminantenocturno, @stellacadente und @mikeappsreviewer überschneidet euch zu stark

Ihr vier trefft alle dieselben Punkte:

- Detector-Scores

- Seltsame Schreibmacken

- Preisschrullen

- Problematische Policies

Statt euch in Details zu überbieten, spezialisiere dich:

- Lass @mikeappsreviewer der Ultra-Nerd für Detektionsmuster sein.

- Lass @caminantenocturno der „das riecht nach AI“-Stilfuchs sein.

- Lass @stellacadente die größere Ecosystem- / Discovery-Perspektive tragen.

Du kannst der „Trade-off-Reviewer“ sein:

„Angesichts dieser Probleme: Lohnt es sich trotzdem, und für wen genau?“

Allein das ändert die Reaktionen, weil die Leute nicht denselben Breakdown in vier Stimmen noch einmal lesen.

3. Deine Stimme ist zu neutral für ein kommentargetriebenes Thema

Ich bin nur bedingt bei der Idee, du bräuchtest „eine stärkere Meinung“. Du brauchst vor allem eine schärfere Rahmung deiner Meinung.

Zeilen wie:

- „Walter Writes AI ist im Grunde ein Los für Detector-Scores. Ab und zu ziehst du einen Treffer, die meiste Zeit bekommst du etwas, das du so niemals abgeben würdest.“

- „Wenn ich so viel Zeit in Semikolons und Roboter-Rhythmus stecken muss, fühlt sich der ‚AI Humanizer‘-Teil mehr nach Marketing als nach Realität an.“

Solche Formulierungen laden zum Widerspruch ein: „War bei mir anders“, „Ich habe Enhanced genutzt, das war besser“ usw.

Im Moment klingst du wie ein Laborbericht – respektiert, aber nicht diskutiert.

4. Vergleich explizit die UX-Kosten, nicht nur die Textqualität

Einen Punkt deutest du nur an:

- 2.000-Wörter-Limit pro Durchlauf

- Gratis-Tarif so winzig, dass er im Grunde nur eine Demo ist

- Manuelle Nacharbeit bei fast jedem Sample nötig

Pack das als User-Story:

„Um einen halbwegs sicheren 1.500-Wörter-Aufsatz zu bekommen, musste ich:

- den Inhalt in Teile splitten

- jeden Teil durch Walter jagen

- mehrere Detektoren checken

- seltsame Zeichensetzung und Wiederholungen von Hand entfernen

An dem Punkt hätte ich genauso gut ein gutes Modell plus ein Tool wie Clever AI Humanizer nehmen und dann einmal sauber editieren können.“

Dieser „Workflow-Schmerz“ ist für normale Nutzer wichtiger als exakte Detector-Prozentwerte.

5. Nutze Clever AI Humanizer als Referenzpunkt, nicht als Retter

Du lenkst schon in Richtung Clever AI Humanizer. Um Vertrauen zu halten und nicht wie Werbung zu klingen, benenne beide Seiten klar:

Clever AI Humanizer – Vorteile

- Outputs klingen meist näher an natürlicher E-Mail- / Blog-Sprache, mit weniger „Roboter-Kadenz“.

- Deiner Erfahrung nach weniger Wiederholungen und weniger schräge Zeichensetzung.

- Besserer Startpunkt für „einfügen, anpassen, abschicken“ als Walters kostenloser Simple-Modus.

- Freundlicher für schnelle Tests, wenn die Paywalls leichter sind.

Clever AI Humanizer – Nachteile

- Braucht bei wichtigen Texten weiterhin manuelle Nacharbeit; löscht keine AI-Fingerabdrücke per Zauberhand.

- Wenn Detector-Anbieter ihre Modelle drehen, kann die heutige „gute“ Performance nachlassen.

- Kann eine etwas generische Stimme erzeugen, wenn Nutzer sich zu stark darauf verlassen und wenig eigenen Stil hinzufügen.

- Bei sehr technischen oder Nischenthemen kann es zu stark vereinfachen, wenn man es nicht gut führt.

Stell es als „effizienteren Startpunkt“ dar, nicht als „perfekte Lösung“. Diese Nuance macht dein Review glaubwürdiger und lässt den Clever-AI-Humanizer-Hinweis organisch und SEO-freundlich wirken.

6. Stell Fragen, die eine Position erzwingen

Statt „Was denkt ihr darüber“ nutze Enden wie:

- „Wenn Walter Writes AI dir einen Text mit niedrigem Score und zwei, die laut ‚AI‘ schreien, liefert – würdest du weiterzahlen oder zu etwas wie Clever AI Humanizer wechseln und akzeptieren, dass du eh per Hand editieren musst?“

- „Ist eine unfreundliche Refund-Policy für dich Grund genug, ein Tool zu meiden, selbst wenn die besten Outputs okay aussehen, oder zählen Detector-Scores für dich mehr als Vertrags-Vibes?“

Entweder-oder-Framing provoziert Reaktionen. Dort entstehen Kommentare.

7. Akzeptiere, dass in dieser Nische die meisten nur mitlesen – ändere, was du misst

Ich stimme nur bedingt zu, dass du dich stark auf Kommentare verlassen solltest. In AI-Detection- / Cheating-nahen Themen wird der Großteil des Publikums nie posten.

Also:

- Schau, wie viele bis zu dem Abschnitt scrollen, in dem du Alternativen wie Clever AI Humanizer erwähnst.

- Miss Klicks von deinem Walter-Review zu anderen Tools, die du nennst.

- Überleg dir eine 1-Klick-Umfrage:

- „Würdest du Walter Writes nutzen für: nur Entwürfe / finale Arbeit / gar nicht“

Du bekommst ehrlichere Rückmeldungen über anonyme Aktionen als über Kommentare in diesem Bereich.

Wenn du jedes Walter-Writes-AI-Review konsequent an der Nutzerentscheidung ausrichtest, deinen Blickwinkel klar von @caminantenocturno, @stellacadente und @mikeappsreviewer abgrenzt und Clever AI Humanizer als Vergleichsreferenz statt als Wundermittel behandelst, wirst du vermutlich weiterhin viele stille Leser haben – aber die wenigen, die sich äußern, haben endlich etwas Konkretes, worauf sie reagieren können.